En deux ans, la création vidéo par intelligence artificielle a basculé d'un gadget de laboratoire à un vrai outil de production. Des agences de marketing s'en servent pour générer des spots en quelques heures. Des formateurs YouTube produisent des cours entiers sans caméra. Des e-commerçants créent des vidéos produits à la demande, sans plateau ni équipe technique.

J'ai commencé à tester Runway Gen-2 dès sa sortie publique, convaincu que quelque chose était en train de changer profondément. Puis sont arrivés Sora, Kling, Pika Labs, Luma Dream Machine : chaque modèle avec ses forces, ses limites et ses cas d'usage spécifiques. Ce texte est le résultat de deux ans d'expérimentation concrète, pas une compilation de fiches produit.

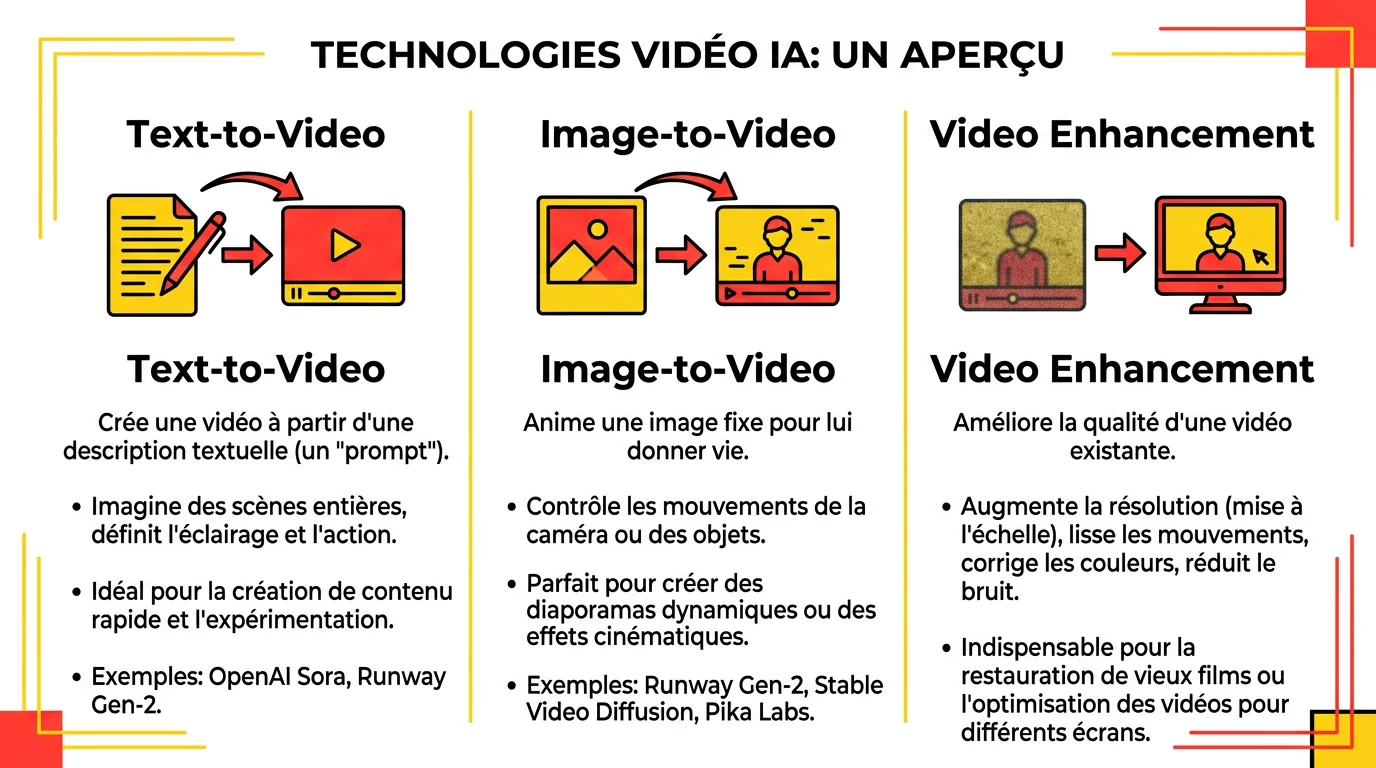

Trois grandes familles de technologies structurent aujourd'hui ce marché : le Text-to-Video (générer une vidéo depuis un texte), l'Image-to-Video (animer une image fixe) et le Video Enhancement (améliorer ou transformer une vidéo existante). Voici ce que chacune vaut vraiment, quels outils dominent, et comment choisir selon votre métier.

Text-to-Video : générer une vidéo depuis un texte

Le Text-to-Video, c'est la promesse la plus spectaculaire de l'IA générative appliquée à la vidéo : écrire une description en langage naturel et obtenir un clip en retour. Vous rédigez un prompt ("Un surfeur chevauche une vague au coucher du soleil, style cinématographique, 4K") et le modèle génère une séquence de quelques secondes à une minute.

La technologie repose sur des modèles de diffusion entraînés sur des milliards d'images et de vidéos. Le modèle apprend les relations spatiales, temporelles et sémantiques entre les pixels. Il reconstruit ensuite une séquence cohérente à partir de votre description textuelle.

Comment fonctionne le pipeline Text-to-Video ?

Le prompt passe d'abord par un encodeur de texte (souvent CLIP ou T5) qui le transforme en vecteurs numériques. Ces vecteurs guident un processus de débruitage itératif sur des trames de pixels. À chaque itération, le modèle affine le résultat jusqu'à obtenir une séquence visuellement cohérente.

Le défi technique majeur reste la cohérence temporelle : maintenir l'identité des objets, des personnages et de la lumière d'une frame à l'autre. C'est précisément là que les modèles divergent le plus en qualité.

Sora (OpenAI) : le modèle qui a tout changé

Sora a été révélé en février 2024 avec des démos qui ont sidéré la communauté. Des vidéos d'une minute, une cohérence spatiale impressionnante. En pratique, l'accès grand public via Sora, le modèle text-to-video d'OpenAI, reste limité à ChatGPT Pro : 50 clips de 480p par mois pour 20 dollars, moins si vous montez en résolution.

La qualité est réelle, mais les limitations aussi. Les mains restent parfois difformes. Les textes dans les vidéos sont souvent illisibles. Et sur des scènes complexes avec plusieurs personnages en interaction, la cohérence se dégrade rapidement. Sora excelle sur les plans larges et les scènes d'ambiance. Il est beaucoup moins à l'aise dès que la précision anatomique entre en jeu.

Kling (Kuaishou) : le sérieux challenger chinois

Kling AI, développé par Kuaishou (l'équivalent chinois de TikTok), s'est imposé comme le concurrent le plus crédible de Sora. Sa version 1.6 génère des clips jusqu'à 3 minutes, avec une cohérence temporelle supérieure à Sora sur certains types de scènes, surtout les mouvements physiques réalistes.

Ces modèles text-to-video se distinguent des assistants IA généralistes comme ChatGPT ou Copilot, qui traitent du texte et des images mais restent sans capacité de génération vidéo native. L'accès international passe par l'app ou le site web de Kling, avec un modèle freemium, et la version payante tourne autour de 10 à 30 dollars par mois selon les besoins.

Runway Gen-3 Alpha : la référence des créatifs

Runway est l'outil que je recommande le plus souvent aux créatifs qui débutent en IA vidéo. L'interface est pensée pour les vidéastes, pas pour les développeurs. Gen-3 Alpha produit des clips de 10 secondes en haute qualité avec une maîtrise du style visuel difficile à trouver ailleurs.

Le vrai avantage de Runway : l'écosystème complet autour de la génération vidéo. Suppression de fond, extension de plan, interpolation d'images et suppression de bruit : tout s'intègre dans un workflow de post-production cohérent. Comptez 15 dollars par mois pour 625 crédits (environ 25 clips de 10 secondes en 720p).

Pika Labs : la créativité avant la technique

Pika 2.0 a surpris en fin d'année 2024 avec une approche différente : moins focalisée sur le réalisme, davantage sur la créativité et l'expérimentation stylistique. L'outil permet de générer des vidéos dans des styles artistiques variés (anime, 3D, illustration) avec une fidélité au prompt supérieure à certains concurrents.

Pour les créateurs de contenu qui cherchent de l'originalité visuelle plutôt que du réalisme photo, Pika reste une option sérieuse, souvent moins chère que Runway pour un usage créatif.

Comparateur outils IA video

| Outil | Type | Prix | Qualite max | Duree max | Note |

|---|

Image-to-Video : animer l'image fixe

L'Image-to-Video consiste à prendre une image statique (photo, illustration, rendu 3D) et à la transformer en séquence animée. C'est souvent plus prévisible que le Text-to-Video pur, car le point de départ est défini. Vous contrôlez le premier frame, le modèle construit la suite.

Les cas d'usage sont larges : e-commerce pour animer des visuels produits, marketing pour donner vie à des illustrations de marque. Ces techniques rejoignent un ensemble plus large d'outils capables d'améliorer la qualité visuelle d'un rendu, comme les logiciels de défloutage ou de restauration d'image.

Luma Dream Machine : l'animation photo la plus naturelle

Luma Dream Machine est aujourd'hui la référence sur l'animation d'images fixes. Sa force principale : produire des mouvements naturels, fluides, sans les artefacts de distorsion qui plombent les résultats d'autres modèles. Donnez-lui une photo de paysage, il ajoutera du vent dans les feuilles et un mouvement de caméra subtil qui donne l'impression d'un vrai plan cinéma.

L'accès est disponible via le site web de Luma AI, avec un niveau gratuit (30 générations par mois) et des plans payants à partir de 30 dollars. Les vidéos sont limitées à 5 secondes, mais la qualité justifie largement cette contrainte pour des usages marketing et créatifs.

Kling en mode Image-to-Video

Kling propose aussi un mode Image-to-Video particulièrement efficace pour les portraits et les scènes humaines. La gestion des expressions faciales et des micro-mouvements est convaincante, là où beaucoup de modèles produisent des effets "deepfake flottant" peu naturels.

Le workflow est simple : uploadez votre image, rédigez un prompt de mouvement ("regard vers la droite, léger sourire, cheveux qui bougent dans le vent"), et Kling génère une animation de 4 à 5 secondes. La cohérence de l'identité visuelle du sujet est maintenue bien mieux que sur des modèles concurrents.

Runway en mode Image + Prompt

Runway permet de combiner une image de référence avec un prompt textuel pour guider le mouvement. C'est l'approche hybride la plus fine du marché : vous définissez le point de départ visuel ET la direction de l'animation. Idéal pour les vidéastes qui veulent un contrôle précis sur le résultat.

Parmi les ressources utiles pour évaluer ces approches, les IA génératives visuelles recensées par Geekeries.fr donnent un panorama complet des outils disponibles, des générateurs d'images aux modèles d'animation.

Video Enhancement : améliorer et transformer

Le Video Enhancement ne crée pas de nouveau contenu : il transforme de la vidéo existante. Upscaling (passer de 720p à 4K), interpolation (doubler les fps pour lisser un mouvement), changement de style visuel, restauration de vidéos anciennes. C'est un domaine distinct du Text-to-Video, souvent plus immédiatement utile pour les professionnels.

Upscaling et restauration avec Topaz Video AI

Topaz Video AI est l'outil de référence pour l'upscaling vidéo. Basé sur des modèles entraînés spécifiquement sur des millions de paires basse/haute résolution, il permet de passer une vidéo 480p à un résultat crédible en 4K, avec une récupération des détails impressionnante. C'est un logiciel desktop (Windows et Mac), à licence unique autour de 300 dollars ou abonnement annuel.

L'interpolation de Topaz avec le modèle Chronos est particulièrement efficace pour lisser des vidéos tournées à 24fps et les passer en 60fps sans les artefacts de mouvement des interpolations classiques.

Style transfer et transformation avec Runway

Runway propose un mode "Video to Video" qui applique une transformation stylistique à une vidéo existante. Vous uploadez un clip, vous décrivez le style souhaité ("peinture à l'huile impressionniste", "animation 3D low poly"), et Runway retranspose chaque frame dans ce style tout en maintenant la cohérence du mouvement.

Le résultat est variable selon la complexité de la scène source. Sur des clips simples avec des sujets bien définis, la transformation est spectaculaire. Sur des plans chargés ou des mouvements rapides, les artefacts s'accumulent.

Adobe Firefly Video : l'option pour les workflows existants

Adobe Firefly Video s'intègre directement dans Premiere Pro et After Effects. Pour les équipes déjà dans l'écosystème Adobe, c'est l'argument massue : générer du B-roll, étendre des plans trop courts, ou modifier l'arrière-plan d'une scène sans quitter son logiciel habituel.

La qualité de Firefly Video est correcte sans rivaliser avec Sora ou Kling sur les sorties pures. Adobe mise sur l'intégration plutôt que sur la performance brute des modèles. L'accès est inclus dans les abonnements Creative Cloud à partir du plan All Apps.

Comparatif des principaux outils en 2026

Voici un tableau récapitulatif des outils testés, avec les données pratiques qui comptent vraiment au moment de choisir.

| Outil | Technologie | Durée max | Résolution max | Prix indicatif | Point fort | Point faible |

|---|---|---|---|---|---|---|

| Sora (OpenAI) | Text-to-Video | 1 minute | 1080p | 20 $/mois (Pro) | Cohérence spatiale, paysages | Crédits limités, mains imparfaites |

| Kling (Kuaishou) | Text + Image-to-Video | 3 minutes | 1080p | 10–30 $/mois | Durée, physique réaliste | Interface parfois instable |

| Runway Gen-3 | Text + Image + Vid-to-Vid | 10 secondes | 1080p | 15 $/mois (Standard) | Écosystème, contrôle stylistique | Clips courts, crédits consommés vite |

| Pika Labs | Text + Image-to-Video | 10 secondes | 1080p | 8–28 $/mois | Créativité, styles artistiques | Moins réaliste sur le photoréalisme |

| Luma Dream Machine | Image-to-Video | 5 secondes | 1080p | 30 $/mois | Fluidité des mouvements naturels | Clips très courts |

| Synthesia | Text-to-Video (avatars) | Illimitée | 1080p | 29 $/mois (Starter) | Avatars, e-learning, 120 langues | Style "corporate", peu naturel |

| HeyGen | Text-to-Video (avatars) | Variable | 1080p | 29 $/mois | Clonage vocal, traduction vidéo | Coût élevé pour grand volume |

| Adobe Firefly Video | Text-to-Video + Enhancement | Variable | 4K | Inclus Creative Cloud | Intégration Premiere/AE | Modèle moins avancé que Sora/Kling |

Deux outils sortent du lot selon l'usage : Runway si vous cherchez un contrôle créatif et un workflow complet, Kling si vous avez besoin de clips plus longs à moindre coût. Sora impressionne mais reste cher et limité en crédits pour un usage professionnel intensif.

Gratuit ou payant : quelles sont les vraies limites ?

Chaque outil propose un niveau gratuit, mais les contraintes sont réelles. Sora gratuit via ChatGPT génère des clips en basse résolution avec un watermark. Kling gratuit limite à 66 crédits par mois, soit environ 10 clips de 5 secondes en 720p. Luma offre 30 générations mensuelles, mais uniquement en 540p sur le plan gratuit.

Pour un usage professionnel (campagne marketing, vidéos produits, contenu YouTube régulier), un abonnement payant s'impose rapidement. Le comparatif Runway, Kling et Pika de Multic.com détaille les différences de crédits et de tarifs pour aider à calibrer ce choix. La vraie question n'est pas "gratuit ou payant" mais "quel outil s'intègre le mieux à mon workflow pour ce que je produis ?"

Au-delà des grands modèles, des outils IA gratuits couvrent des besoins spécifiques (upscaling, sous-titrage automatique, suppression de fond vidéo) et peuvent compléter un workflow sans alourdir la facture mensuelle.

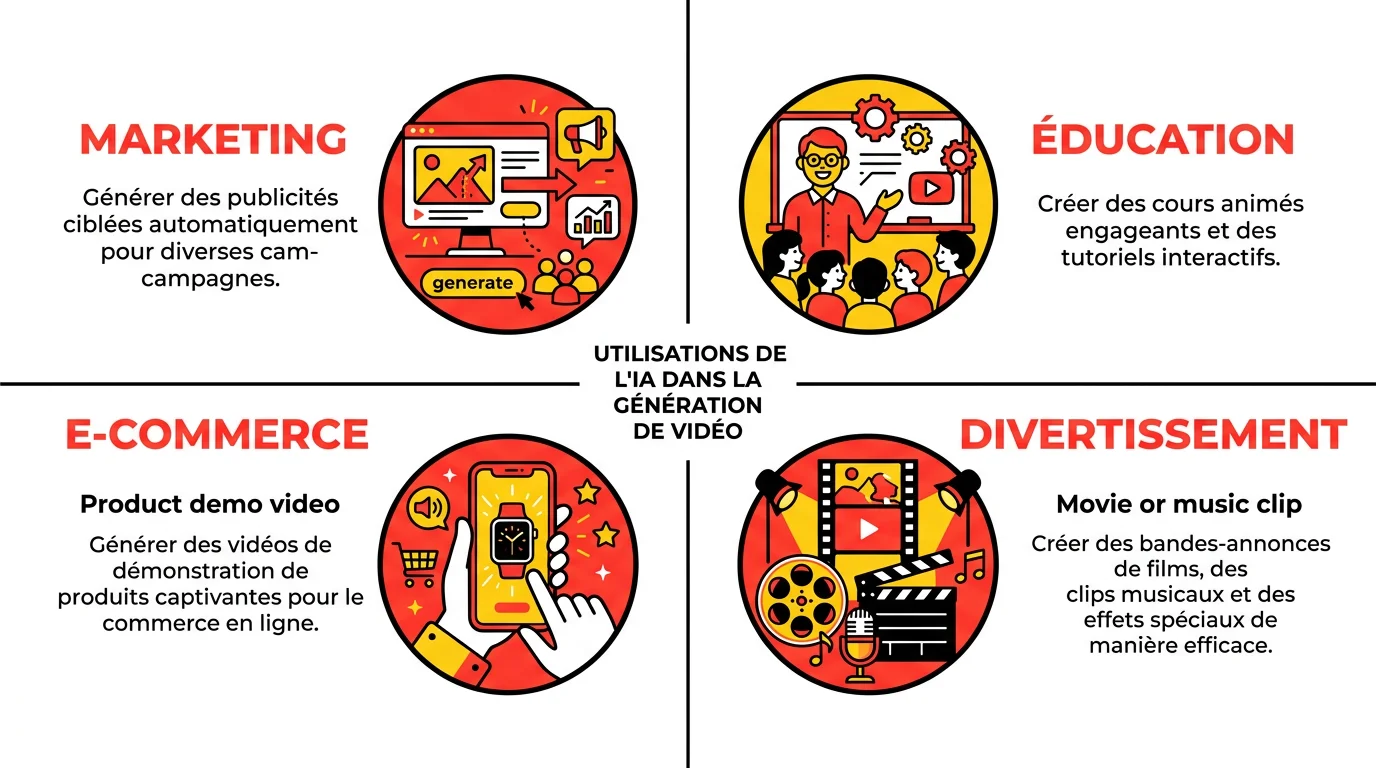

Cas d'usage par secteur d'activité

L'IA création vidéo ne s'utilise pas de la même façon selon que vous êtes marketeur, formateur, e-commerçant ou créateur de contenu. Voici les applications concrètes qui fonctionnent vraiment, testées ou observées sur des projets réels.

Marketing et publicité : le B-roll à la demande

La première application qui convainc les équipes marketing : générer du B-roll. Les clips d'ambiance, de contexte, d'illustration (qui représentent souvent 60% du temps de montage et 40% du budget vidéo) peuvent maintenant être produits en quelques minutes. Un marketeur peut générer 10 variantes d'un même concept visuel en une heure, tester les formats sur les réseaux sociaux, et ne commander une vraie production que pour ce qui performe.

Les agences pionnières utilisent Runway ou Kling pour les rushes d'ambiance, et gardent la production humaine pour les scènes avec des acteurs réels ou des produits physiques à présenter en détail. Le gain de temps sur les petits projets est massif, souvent 70 à 80% du budget d'un spot web. Certaines plateformes permettent également d'automatiser sa stratégie marketing en intégrant ces flux de génération vidéo dans des campagnes cross-canal pilotées par l'IA.

Formation et e-learning : Synthesia et HeyGen en tête

Pour la formation professionnelle, les avatars IA de Synthesia et HeyGen ont trouvé leur marché. Créer un module e-learning avec un présentateur humain coûtait jusqu'à 5 000 euros par heure de contenu (tournage, studio, montage). Avec un avatar IA, ce coût tombe à quelques centaines d'euros, et la mise à jour du contenu se fait en quelques minutes : juste modifier le texte du script.

J'ai pu observer des organismes de formation qui ont multiplié par dix leur production de contenus vidéo en adoptant Synthesia. La limite principale reste l'aspect "corporate" des avatars : ils conviennent bien pour des formations procédurales, moins pour des contenus qui demandent une connexion émotionnelle forte avec l'apprenant.

E-commerce : animer le catalogue produit

L'Image-to-Video ouvre des possibilités concrètes pour le e-commerce. Vous avez des photos produit de qualité ? Luma Dream Machine ou Kling peuvent les transformer en clips animés de 5 secondes : un sac à main qui tourne lentement, une chaussure présentée sous différents angles, un vêtement porté avec des mouvements naturels.

Sur les fiches produit et les publicités sociales, ces clips court-métrages génèrent des taux d'engagement nettement supérieurs aux images statiques. Plusieurs études de cas (Shopify, Meta for Business) montrent des augmentations de 30 à 60% du taux de clic sur les publicités vidéo versus photo pour des produits de mode et décoration.

Divertissement et création indépendante

Les créateurs indépendants (YouTubeurs, auteurs de courts-métrages, artistes numériques) trouvent dans ces outils un moyen de réaliser des productions qui dépasseraient leurs moyens habituels. Un réalisateur solo peut générer des effets spéciaux, des décors impossibles à filmer, des scènes d'animation, sans budget Hollywood. Dans ce registre, l'IA d'OpusClip, qui transforme des vidéos courtes en shorts pour Youtube, s'est imposée comme un complément naturel pour maximiser la portée de ces productions sur les plateformes courtes.

Le revers : la démocratisation de ces outils crée une inflation de contenu généré. Les créateurs qui s'en sortent sont ceux qui utilisent l'IA comme un amplificateur de leur vision artistique, pas comme un remplacement de l'idée. La direction artistique reste humaine. L'exécution, elle, peut être augmentée par la machine.

Droits, RGPD et EU AI Act : ce que dit la loi

La question juridique est celle que personne ne veut aborder franchement dans les guides sur l'IA vidéo. Et pourtant, elle peut coûter très cher à ignorer. Voici l'état réel du cadre légal en 2026, en Europe, pour les professionnels qui utilisent ces outils.

À qui appartient la vidéo générée par IA ?

En droit français et européen, une œuvre générée entièrement par une IA, sans contribution créative humaine suffisante, n'est pas protégeable par le droit d'auteur. Il n'y a pas d'auteur au sens juridique. Cela signifie que votre vidéo générée par Sora ou Kling peut théoriquement être copiée et réutilisée par n'importe qui sans que vous puissiez vous y opposer sur le terrain du droit d'auteur.

En pratique, les tribunaux n'ont pas encore tranché de manière définitive sur ces cas. La jurisprudence se construit. Mais le principe est clair : plus vous apportez de contribution créative (choix du prompt précis, édition du résultat, combinaison avec des éléments originaux), plus vous renforcez vos droits sur l'œuvre finale.

L'EU AI Act et les obligations des fournisseurs

L'EU AI Act, entré progressivement en application depuis août 2024, impose des obligations de transparence aux fournisseurs de systèmes d'IA générative. Les vidéos générées par IA doivent pouvoir être identifiées comme telles : les plateformes sont tenues de mettre en place des mécanismes de watermarking ou de marquage des contenus. La réglementation européenne sur l'IA, adoptée par le Parlement européen, précise les catégories de risques et les obligations associées pour chaque type de système.

Concrètement pour les utilisateurs professionnels : si vous publiez des vidéos générées par IA dans un contexte commercial ou éditorial, vous avez l'obligation de mentionner leur origine dans la plupart des contextes. Les plateformes comme YouTube et Meta demandent déjà cette déclaration dans leurs règles d'utilisation. L'absence de mention peut constituer une pratique commerciale trompeuse.

RGPD et données d'entraînement : le point sensible

Les modèles de génération vidéo ont été entraînés sur des corpus massifs d'images et de vidéos collectés sur le web. La question de la légalité de ces données d'entraînement fait l'objet de plusieurs actions judiciaires en cours en Europe et aux États-Unis. Getty Images a attaqué Stability AI. Des acteurs et artistes ont engagé des procédures collectives contre plusieurs fournisseurs.

Pour l'utilisateur final, le risque juridique direct est limité mais non nul : si le contenu généré reproduit de manière trop fidèle une œuvre protégée présente dans les données d'entraînement, une responsabilité peut être engagée. Sur ce volet, les obligations RGPD liées à l'IA publiées par la CNIL rappellent que le traitement de données personnelles dans les systèmes génératifs impose une information claire des personnes concernées. La prudence s'impose sur les styles très spécifiques liés à un artiste identifiable.

Deepfakes et usages interdits

L'usage des outils d'Image-to-Video ou de clonage vocal (HeyGen, ElevenLabs combiné) pour générer des vidéos de personnes réelles sans leur consentement est illégal dans la quasi-totalité des juridictions européennes. Le droit à l'image est clairement établi. La loi SREN en France (2024) a durci les sanctions sur les deepfakes non consentis, avec des peines pouvant aller jusqu'à 2 ans d'emprisonnement et 30 000 euros d'amende.

Limites actuelles et angles morts

Après deux ans à tester ces outils régulièrement, voici les limites que personne ne mentionne assez clairement dans les communiqués de presse.

La cohérence temporelle : le problème non résolu

Le principal défi technique des modèles Text-to-Video reste la cohérence temporelle sur des clips longs. Au-delà de 10 à 15 secondes, les modèles actuels peinent à maintenir l'identité des sujets et la logique physique des mouvements. Un personnage peut voir ses traits changer légèrement d'une seconde à l'autre. Un objet peut disparaître puis réapparaître différent.

Sora a réduit ce problème, Kling aussi, mais aucun modèle ne le résout complètement en 2026. Pour des clips de moins de 10 secondes avec des compositions simples, le résultat est professionnel. Pour des narrations longues avec des personnages récurrents, il faut encore compter sur un humain pour assurer la continuité.

Le coût réel en production intensive

Les abonnements affichés (15 à 30 dollars par mois) sont trompeurs pour un usage professionnel intensif. Les crédits s'épuisent vite : en 720p, Runway Gen-3 consomme environ 5 crédits par seconde de vidéo. Un plan Standard à 625 crédits donne environ 125 secondes de vidéo, soit un peu plus de 2 minutes. Pour produire 10 minutes de contenu mensuel, il faut le plan Pro à 2 250 crédits, soit 35 dollars.

En 2025, le rapport du Monde sur les vidéos IA génératives qui ont envahi les réseaux sociaux illustrait ce basculement : des milliers de créateurs ont adopté ces outils sans en maîtriser les coûts réels, générant une inflation de contenu bas de gamme. En production intensive (agence, studio), les budgets mensuels peuvent rapidement atteindre 200 à 500 euros pour une petite équipe.

Les biais et la diversité : un point de vigilance

Les modèles entraînés sur des corpus web reproduisent les biais de représentation présents dans ces données. Par défaut, Sora et Runway ont tendance à générer des personnages aux caractéristiques démographiques surreprésentées dans les données d'entraînement : majoritairement jeunes, blancs, occidentaux. Un prompt neutre comme "un professionnel en réunion" produira le plus souvent une représentation peu diverse.

Les équipes de contenu qui ont des exigences de représentation, et c'est de plus en plus le cas dans les grandes entreprises, doivent travailler le prompt de manière explicite pour corriger ces biais. Ce n'est pas insurmontable, mais c'est un effort conscient à intégrer dans le workflow.

Où va l'IA vidéo en 2026 et au-delà ?

Ces modèles progressent à une vitesse que l'histoire des technologies créatives n'a guère connue avant 2023. Quelques directions se dessinent pour les prochains 18 mois.

La cohérence multi-scènes : le prochain saut

Le vrai défi que les laboratoires cherchent à résoudre est la cohérence d'un personnage sur plusieurs scènes distinctes. Aujourd'hui, si vous générez 5 clips différents avec "le même personnage", vous obtiendrez 5 personnages légèrement différents. Les prochaines versions de Sora, Kling et Runway travaillent sur des mécanismes d'"identité persistante" qui permettront de verrouiller un personnage et de le retrouver cohérent d'un clip à l'autre.

Quand cette fonctionnalité sera mature, la production de courts-métrages entiers par IA deviendra réaliste. Des expérimentations existent déjà : des réalisateurs ont produit des films de 10 à 20 minutes avec des résultats convaincants en passant des heures à sélectionner les meilleures générations.

L'audio intégré : vers la vidéo complète

La génération vidéo sans son reste un angle mort majeur. Les modèles actuels produisent des clips muets que l'utilisateur doit habiller en post-production avec de la musique et des effets sonores séparés. Plusieurs modèles (dont une évolution annoncée de Sora et des projets comme Stable Audio Video) travaillent sur la génération simultanée du son et de l'image.

La synchronisation audio-vidéo est un problème technique redoutable (les sons doivent correspondre aux mouvements visuels de manière cohérente), mais les progrès sont rapides. Dans 12 à 18 mois, il est probable que les outils de référence proposent une génération vidéo complète avec son ambiant intégré.

Vers une démocratisation des effets spéciaux

Le Video Enhancement va continuer à progresser vers la démocratisation des effets visuels de niveau cinéma. Ajouter un fond de ciel étoilé à une scène tournée en studio, intégrer un personnage 3D dans une vraie scène filmée, changer la météo d'un plan extérieur : des opérations qui demandaient des compositeurs spécialisés et des heures de travail vont devenir accessibles en quelques clics. Ce mouvement témoigne d'une tendance plus large : l'accessibilité de l'IA à des métiers jusque-là éloignés des technologies de pointe, des artisans aux PME, en passant par les créateurs solo.

Adobe, avec Firefly Video intégré à After Effects, est le mieux positionné pour démocratiser ces usages auprès des professionnels déjà dans son écosystème. Les indépendants et petites agences qui ont jusque-là sous-traité ces effets vont pouvoir les intégrer en interne.

La régulation va s'intensifier

L'EU AI Act n'est que le début. Des législations spécifiques sur les contenus synthétiques sont en discussion dans plusieurs États membres. Le débat sur la rémunération des artistes dont les œuvres ont été utilisées pour entraîner ces modèles n'est pas clos, il va au contraire s'intensifier avec les premières décisions judiciaires attendues en 2026-2027.

Pour les professionnels qui intègrent ces outils dans leur production, se tenir informé du cadre réglementaire n'est pas optionnel. Un usage légal aujourd'hui peut ne plus l'être dans 12 mois si les tribunaux ou les législateurs bougent. La qualité de rendu que les outils actuels peuvent atteindre rend d'autant plus nécessaire un cadre juridique clair.

Questions fréquentes sur l'IA création vidéo

- Quelle est la différence entre Text-to-Video et Image-to-Video ?

- Le Text-to-Video génère une vidéo entière depuis une description textuelle, sans image de départ. L'Image-to-Video prend une image fixe existante et l'anime selon un prompt de mouvement. Le Text-to-Video offre plus de liberté créative, l'Image-to-Video donne plus de contrôle sur l'apparence du résultat, puisque le premier frame est défini par l'utilisateur.

- Peut-on utiliser les vidéos générées par IA à des fins commerciales ?

- Cela dépend des conditions d'utilisation de chaque outil. Runway, Kling et Luma autorisent l'usage commercial sur leurs plans payants. Sora l'autorise pour les abonnés Pro. Vérifiez toujours les CGU de l'outil utilisé, car certaines limitations s'appliquent sur le contenu de la vidéo (personnages ressemblant à des personnes réelles, logos de marques, etc.). En Europe, les obligations de mention d'origine IA s'appliquent dans les contextes éditoriaux et publicitaires.

- Quel outil IA vidéo choisir pour débuter sans budget ?

- Luma Dream Machine offre 30 générations gratuites par mois, ce qui est suffisant pour expérimenter sérieusement. Kling propose un niveau gratuit avec 66 crédits mensuels. Runway donne 125 crédits gratuits à l'inscription, mais ils s'épuisent vite. Pour commencer sans dépenser, Luma est le meilleur compromis qualité-générosité du niveau gratuit.

- Les vidéos générées par IA sont-elles détectables ?

- En 2026, les vidéos de bonne qualité ne sont pas systématiquement détectables à l'œil nu, surtout sur des clips courts et des scènes simples. Des outils de détection existent (Hive Moderation, Intel FakeCatcher) mais ne sont pas infaillibles. L'EU AI Act impose aux fournisseurs de mettre en place des mécanismes de watermarking numérique invisible : ces marqueurs peuvent être détectés par des outils spécialisés, mais pas par l'utilisateur ordinaire.

- Combien coûte réellement la production vidéo IA en entreprise ?

- Pour un usage professionnel régulier (20 à 50 clips par mois), comptez entre 50 et 200 euros par mois selon les outils et les volumes. Un workflow complet avec Runway Gen-3 (35 euros/mois plan Pro) + Topaz Video AI (abonnement annuel environ 15 euros/mois amorti) représente un budget maîtrisable pour une petite agence ou un département marketing.

- L'IA peut-elle remplacer une équipe de production vidéo ?

- Pas entièrement, et probablement pas dans les 5 prochaines années pour des productions qui demandent des personnes réelles, des produits physiques précis ou une connexion émotionnelle forte. L'IA excelle comme amplificateur de production : B-roll, ambiances, animations, tutoriels avec avatars. Elle libère du temps sur les tâches répétitives pour que les équipes se concentrent sur la direction artistique et les scènes à forte valeur ajoutée humaine.

- Sora est-il vraiment le meilleur outil IA vidéo en 2026 ?

- Sora est le modèle le plus médiatisé, pas nécessairement le meilleur pour chaque cas d'usage. Sur la cohérence spatiale et les scènes d'ambiance, il est en tête. Mais Kling surpasse Sora sur la durée des clips et la physique des mouvements. Runway domine sur le contrôle stylistique et l'intégration dans un workflow de post-production. Le "meilleur" outil dépend entièrement de ce que vous produisez.